Zero-ETL na Prática: Como Integrar Dados sem ETL Tradicional

Imagine esperar horas por um pipeline só para ver um relatório atrasar outra vez. Já passei por isso. E é por isso que a integração sem ETL clássico ganhou espaço. Em vez de extrair, transformar e carregar tudo em lotes, a informação flui quase direto da fonte para onde ela é consultada. Parece simples. E, na prática, muitas vezes é.

Quando falamos de Zero-ETL, falamos de conexões nativas entre sistemas, replicação quase instantânea e consultas que olham várias fontes como se fosse uma só.

O que muda de verdade

Antes, o dado saía da origem, passava por transformações pesadas e só então chegava ao destino. Agora, a lógica é reduzir movimentos e processamentos. Trazer o mínimo. Consultar o máximo na origem. Automatizar o resto.

Menos cópia. Mais conexão.

Componentes chaves

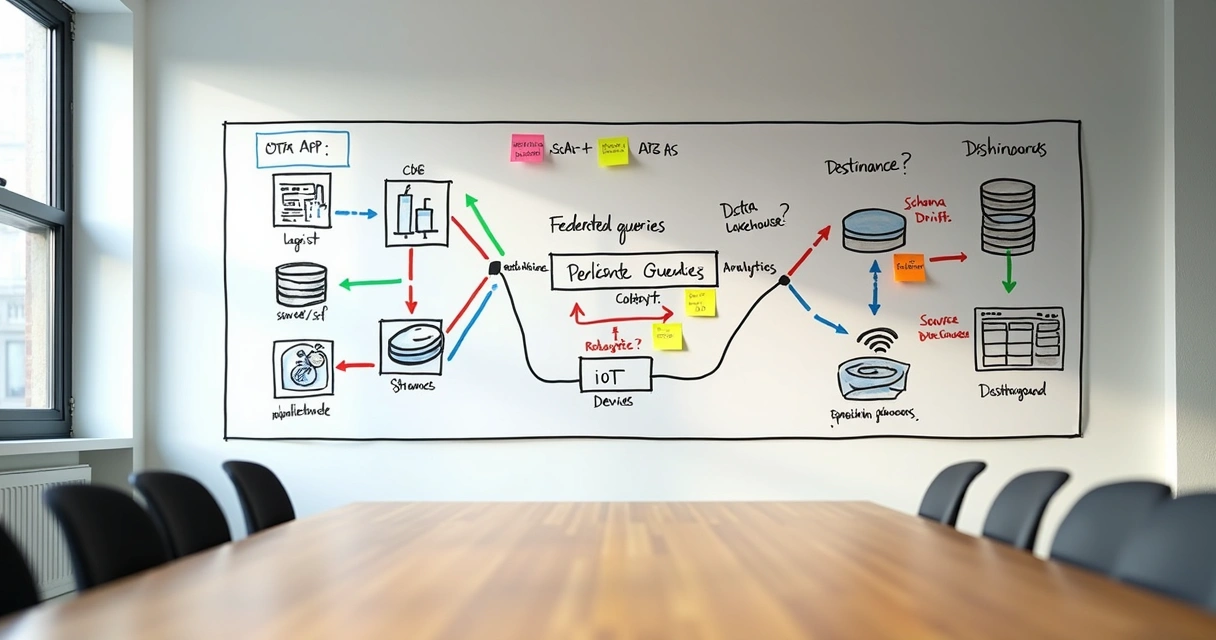

- Replicação nativa: A origem publica as mudanças. O destino recebe quase em tempo real. Em Azure, pense em sincronizar de um banco transacional para um Lakehouse no Fabric, ou para Azure SQL, usando captura de alterações. Sem jobs noturnos enormes.

- Consultas federadas: Você consulta múltiplas fontes como se fossem tabelas de um mesmo lugar. Pode ser uma camada SQL apontando para arquivos no Data Lake e, ao mesmo tempo, para um banco relacional. Em Power BI, modelos compostos fazem algo parecido, unindo DirectQuery com dados importados.

- Streaming de dados: Eventos entram e já viram consulta. No Azure, é comum usar um hub de eventos com processamento em tempo quase real e gravação dos dados no Data Lake. Assim, dashboards atualizam em minutos ou segundos.

Comparação direta

Comparação direta

- ETL tradicional: Lotes, janelas fixas, alto acoplamento entre jobs. Mais controle sobre regras de negócio, mas ciclos longos e infraestrutura pesada.

- Integração sem ETL clássico: Menos transformação no meio. Dados prontos mais cedo. Menos fricção para chegar no BI e no lake. Porém, requer atenção a governança e controle de custos de consulta cruzada.

Desafios existem. Esquemas mudam. Fontes ficam instáveis. Consultar muitas origens ao vivo pode sair caro se virar rotina de todo mundo. Acho ideal, quando possível, colocar uma camada de cache tático ou agregações. Pode resolver em 80% dos casos.

Benefícios claros

- Quase tempo real: Decisões mais rápidas. Alertas antes do problema crescer.

- Menos manutenção: Menos pipelines para refatorar a cada mudança de campo.

- Custos mais baixos: Menos cópias, menos armazenamento duplicado e menos servidores ociosos.

- Automação: Conexões gerenciadas cuidam de reprocessos, checkpoints e falhas.

Exemplos práticos com Azure

Três cenas, bem do dia a dia:

- E-commerce: Pedidos em um banco operacional replicam em minutos para o Lakehouse no Fabric. O Power BI lê direto do formato de alto desempenho, sem refazer cargas noturnas. A equipe de vendas vê cancelamentos quase em tempo real.

- Atendimento: Um CRM no Dataverse envia mudanças para análises no Azure. Sem ETL diário, os líderes acompanham volume de tickets e SLA com latência pequena. Ajustes de equipe ficam mais fáceis.

- IoT e logs: Telemetria entra por um hub de eventos, segue para processamento de streaming e cai no Data Lake em minutos. Alertas disparam quando a temperatura passa do limite. Sem esperar a carga da madrugada.

Como começar, sem drama

Como começar, sem drama

- Mapeie fontes e latência: O que precisa de minuto a minuto, e o que pode esperar uma hora.

- Escolha o padrão: Replicar, federar ou “streamar”. Às vezes, combina.

- Use serviços gerenciados: No Azure, conectores nativos, lakehouse e camadas SQL reduzem código.

- Defina governança: Catálogo, máscara de dados, RBAC. Sem isso, vira caos.

- Monitore: Latência, custos de consulta e mudanças de esquema.

Conclusão

Integração sem ETL tradicional não é mágica. É escolha de arquitetura. Quando bem aplicada, corta caminhos e acelera análises. Em Azure, as peças já existem e conversam bem. Comece pequeno, escolha um fluxo, meça a latência e os custos. Ajuste. Repita. Aos poucos, a fila de pipelines some e a informação chega quando precisa chegar. Simples o bastante. E bom o suficiente.

Sobre o Autor

0 Comentários